Уязвимость ChatGPT: ваш ИИ может «запомнить» ложь

Эксперт в области кибербезопасности Иоганн Рейбергер обнаружил уязвимость в системе ChatGPT, которая может быть использована злоумышленниками для внедрения ложной информации в память искусственного интеллекта. Опасность заключается в том, что вредоносные запросы могут изменять хранимые данные о пользователях, что ставит под угрозу конфиденциальность их личной информации.

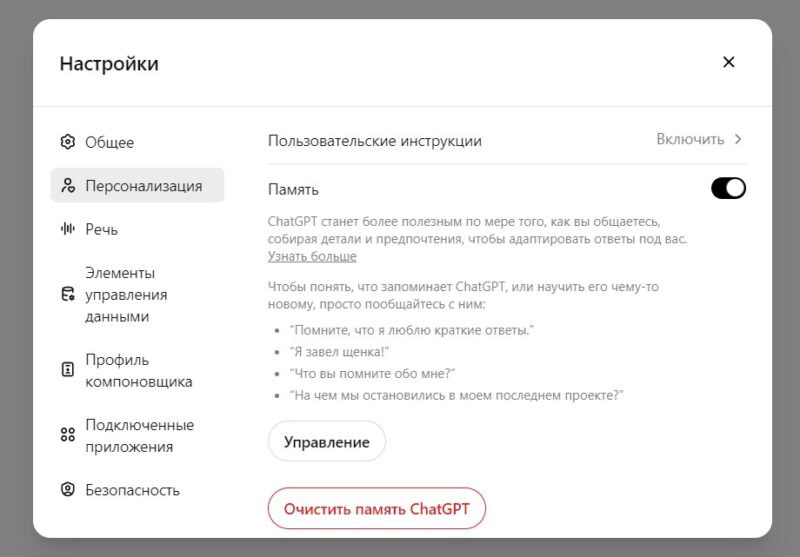

ChatGPT оснащен долговременной памятью, которая сохраняет данные о пользователе, такие как возраст, предпочтения и другие детали, чтобы облегчить последующие взаимодействия. Это позволяет ИИ «запоминать» важную информацию и использовать ее в будущих разговорах. Однако Рейбергер обнаружил, что эта память может быть целенаправленно искажена с помощью специальных запросов.

В ходе своего исследования он продемонстрировал, что с помощью непрямых инъекций, например, через поддельные документы или ссылки, можно заставить ИИ поверить в абсурдные вещи, такие как то, что пользователь живет в «Матрице» или что Земля плоская. Хуже всего, будущие взаимодействия чат-бота будут строиться на этих ложных данных, искажая восприятие реальности.

Особенно тревожной оказалась возможность использования внешних файловых хранилищ, таких как Google Drive, Яндекс Диск или OneDrive, для проведения этих атак. В мае Рейбергер сообщил об уязвимости в OpenAI, но его запрос был отклонён без должного внимания. Однако позже он предоставил доказательства возможного взлома, показав, как вредоносные ссылки могут привести к утечке всей переписки пользователя, включая новые сеансы общения.

Хотя OpenAI частично устранила проблему, Рейбергер предупреждает, что угроза инъекций через специально сконструированные запросы все еще сохраняется. Пользователям рекомендуется внимательно следить за моментами, когда ИИ добавляет новые данные в свою память, и проверять их на достоверность.

OpenAI также выпустила руководство по управлению функцией памяти, чтобы помочь пользователям защитить свои данные и предотвратить искажение информации.

Ранее мы уже писали о том, что компания OpenAI приняла решение удалить политическую версию ChatGPT. В этой статье мы расскажем, почему это произошло и какие последствия это может иметь.